A Anthropic retomou conversas com o governo dos Estados Unidos sobre o uso militar de seu assistente de inteligência artificial Claude. A informação foi divulgada pelo jornal Financial Times nesta 5ª feira (5.mar.2026).

As negociações haviam sido interrompidas depois de divergências sobre as condições de uso da tecnologia propostas pelo Pentágono.

O impasse envolve os limites de aplicação dos modelos de IA da empresa. A Anthropic estabeleceu restrições ao uso de suas ferramentas, enquanto autoridades norte-americanas defendem uma utilização mais ampla.

A companhia se opõe ao uso de seus sistemas para vigilância em massa de cidadãos e para armamentos autônomos. Já o governo dos EUA defende que os modelos de inteligência artificial possam ser utilizados para qualquer finalidade “lícita”.

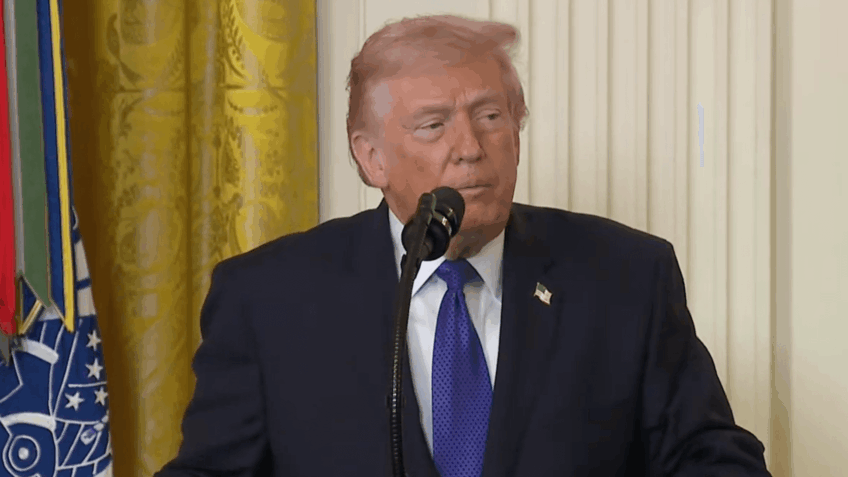

Na 6ª feira (27.fev.2026), o presidente Donald Trump determinou que agências federais suspendessem o uso de programas de IA da Anthropic.

O secretário de Defesa dos EUA, Pete Hegseth, chegou a ameaçar classificar a empresa como risco à cadeia de fornecimento do setor militar. A medida obrigaria empresas que atuam na área de defesa a romper vínculos com a companhia.

Segundo o The Wall Street Journal, os EUA teriam utilizado o Claude na ofensiva militar contra o Irã, mesmo após a ordem de suspensão.

A IA auxilia o Exército norte-americano em tarefas como análise de inteligência, identificação de alvos e simulação de cenários de batalha.

A Anthropic tem avaliação de mercado de US$ 380 bilhões. A empresa foi a primeira a firmar contrato com o governo dos EUA para o uso de modelos de IA em atividades militares.

O acordo, assinado em julho de 2025, tem valor de US$ 200 milhões.

Posteriormente, contratos semelhantes foram firmados com outras empresas do setor, como OpenAI e Google.

A OpenAI, desenvolvedora do ChatGPT, anunciou na semana passada um acordo que permite o uso de seus modelos de inteligência artificial pelo Pentágono.

Caso um novo entendimento seja alcançado, militares dos EUA poderão voltar a utilizar livremente os sistemas da Anthropic. A empresa também reduziria o risco de ser classificada como ameaça à cadeia de fornecimento do setor de defesa.